Hola,

me remiten desde el area de cliente al foro para ver si puedo resolver el problema que tengo con el uso de recursos del servidor, en mi web wordpres-woocommerce. Desde hace un par de dias se ha disparado brutalmente el consumo de recursos, me dicen desde ticket que: El tráfico que aparece con el user agent meta-externalagent corresponde al crawler oficial de Meta (Facebook/Instagram), que accede a tu web para rastrear su contenido.

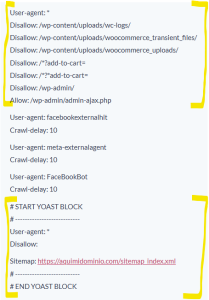

Revisando esta guia: https://www.webempresa.com/blog/como-configurar-crawl-delay-en-tu-archivo-robots-txt.html, he creado desde Yoast seo el archivo robots.txt, añadiendo User-agent/ Crawl-delay, pero parece que no funciona. Os indico como ha quedado el archivo robots.txt:

User-agent: *

Disallow: /wp-content/uploads/wc-logs/

Disallow: /wp-content/uploads/woocommerce_transient_files/

Disallow: /wp-content/uploads/woocommerce_uploads/

Disallow: /*?add-to-cart=

Disallow: /*?*add-to-cart=

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

User-agent: facebookexternalhit

Crawl-delay: 10

User-agent: meta-externalagent

Crawl-delay: 10

User-agent: FaceBookBot

Crawl-delay: 10

# START YOAST BLOCK

# ---------------------------

User-agent: *

Disallow:

Sitemap: https://aquimidominio.com/sitemap_index.xml

# ---------------------------

# END YOAST BLOCK

Aún así, sigue con el consumo prácticamente todo el tiempo al 100%, y se cuelga la web, si me podéis ayudar con esto,

Gracias de antemano,

Laura

Que tal Laura,

Gracias por explicar con detalle tu consulta

Como has mencionado, por defecto, el "Claw-delay" es ignorado por completo por las plataformas de Meta (sea FB o IG)

Por otro lado parece que hay una incongruencia en el archivo de robots.txt donde se declara primero

User-agent: *

Disallow: /wp-content/uploads/wc-logs/

Pero mas abajo vuelve a aparecer

User-agent: *

Disallow:

Dependiendo del robot que analice el archivo, tomará en cuenta es la última declaración y no la primera, esto se debe resolver

Regresando al tema de los recursos, hay alternativas que puedes contemplar para optimizar los tiempos de carga, aumentar la seguridad y ahorrar el consumo de recursos que estas teniendo actualmente

Por un lado puedes establecer un bloqueo a los bots provenientes de Meta desde reglas estipuladas en el .htaccess

RewriteEngine On

RewriteCond %{HTTP_USER_AGENT} meta-externalagent [NC]

RewriteRule .* - [F,L]

Por otro lado puedes configurar Cloudflare a tu sitio en WordPress el cual aplica una capa de seguridad extra ademas de su servicio de CDN el cual servira una caché estática a los bots

Incluso es posible establecer bloqueos directamente desde Cloudflare agregando los agentes a limitar, que en este caso sería el de "meta-externalagent"

Te dejaré enlaces de interés al respecto

- https://www.webempresa.com/blog/cdn-de-cloudflare-en-wordpress.html

- https://developers.cloudflare.com/waf/tools/user-agent-blocking/

Saludos!

Gracias por responder tan rápido, si me puedes resolver una duda, es algo que ha sucedido a raiz de configuración del pixel de meta(que he desvinculado inmediatamente al tener este problema), o no tiene nada que ver con la configuración de mi web, es algo aleatorio de meta en los rastreos de meta?

Y volviendo a las posibles soluciones,

-Primero: ¿que tengo que eliminar aquí?:

"User-agent: *

Disallow: /wp-content/uploads/wc-logs/

Pero mas abajo vuelve a aparecer

User-agent: *

Disallow:"

No me interesa que se desindexe el sitio de google, además utilizo Google Ads, solamente cerrar acceso a los bots de Meta. Adjunto pantallazo, lo que está en amarillo lo ha generado el plugin Yoast al crear el archivo robots.txt, lo del centro es lo que he añadido para intentar bloquear los bots.

Y segundo: configuraré Cloudflare, a ver si así voy acotando.

Gracias de nuevo,

Laura

Hola Laura,

es algo que ha sucedido a raiz de configuración del pixel de meta(que he desvinculado inmediatamente al tener este problema), o no tiene nada que ver con la configuración de mi web, es algo aleatorio de meta en los rastreos de meta?

La integración de un píxel no debería manifestarse en el consumo excesivo de recursos por medio de consultas del crawler de meta

Por otro lado este es el apartado que se debe eliminar para evitar conflictos en el archivo de robots.txt

User-agent: *

Disallow:"

Por ultimo

Y segundo: configuraré Cloudflare, a ver si así voy acotando.

Genial, cualquier duda que tengas estaremos atentos

Saludos!